Volljurist und Compliance-Experte

16 Dec 2025

5 Minuten

Als Jurist mit langjähriger Erfahrung als Anwalt für Datenschutz und IT-Recht kennt Niklas die Antwort auf so gut wie jede Frage im Bereich der digitalen Compliance. Er war in der Vergangenheit unter anderem für Taylor Wessing und Amazon tätig. Als Gründer und Geschäftsführer von SECJUR, lässt Niklas sein Wissen vor allem in die Produktentwicklung unserer Compliance-Automatisierungsplattform einfließen.

Hochrisiko-KI benötigt strenge Datenqualität, Cybersicherheit und klare menschliche Aufsicht, um EU-AI-Act-konform zu sein.

Eine saubere Dokumentation ist unverzichtbar, da sie die technische Funktionsweise, Risiken und Governance des Systems nachweisbar macht.

Bias-Analysen, robuste Sicherheitsmechanismen und nachvollziehbare Modelle sind zentrale Voraussetzungen für vertrauenswürdige KI.

Compliance ist kein einmaliger Check, sondern ein kontinuierlicher Prozess über den gesamten Lebenszyklus der KI hinweg.

Stellen Sie sich vor, Sie starten den Motor eines brandneuen, KI-gesteuerten Autos. Sie vertrauen darauf, dass jeder Sensor, jede Codezeile und jeder Datensatz rigoros geprüft wurde. Sie vertrauen darauf, dass es nicht nur intelligent, sondern auch sicher, robust und zuverlässig ist. Genau dieses Vertrauen will der EU AI Act für künstliche Intelligenz schaffen – insbesondere für sogenannte Hochrisiko-KI-Systeme.

Doch für Entwickler, Produktmanager und Compliance-Verantwortliche fühlt sich dieser Weg oft wie eine Fahrt durch dichten Nebel an. Die Anforderungen sind komplex, die Konsequenzen bei Nichteinhaltung gravierend – Strafen von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes sind eine deutliche Ansage.

Dieser Leitfaden ist Ihre Navigationshilfe. Wir übersetzen die juristischen Anforderungen in eine klare, technische Sprache und zeigen Ihnen die drei entscheidenden Säulen, auf denen jedes konforme Hochrisiko-KI-System stehen muss: Datenqualität, Cybersicherheit und menschliche Aufsicht. Betrachten Sie dies nicht als Belastung, sondern als Bauplan für erstklassige, vertrauenswürdige und marktführende KI.

Bevor Sie sich in die technischen Details stürzen, muss die wichtigste Frage geklärt werden: Fällt Ihr KI-System überhaupt in die Kategorie „Hochrisiko“? Der AI Act teilt KI-Systeme in verschiedene Risikostufen ein, von minimal bis inakzeptabel. Die strengsten Regeln gelten für Hochrisiko-Systeme, da diese die Gesundheit, Sicherheit oder Grundrechte von Personen gefährden könnten.

Typische Beispiele sind KI-Anwendungen in der medizinischen Diagnostik, im Recruiting (Sortierung von Bewerbungen), bei der Kreditwürdigkeitsprüfung oder in kritischen Infrastrukturen. Die genaue Risikoklassifizierung von KI-Systemen ist der erste und wichtigste Schritt auf Ihrem Weg zur Compliance.

Um Ihnen diese Analyse zu erleichtern, haben wir einen einfachen Entscheidungsbaum entwickelt.

Dieser Entscheidungsbaum hilft Entwicklern, Compliance-Beauftragten und Führungskräften schnell zu ermitteln, ob ihr KI-System den Hochrisiko-Kategorien des EU AI Acts entspricht – ein essenzieller erster Schritt zur rechtskonformen Implementierung.

Wenn Sie nach dieser Prüfung feststellen, dass Ihr System als Hochrisiko eingestuft wird, sind die folgenden technischen Säulen für Sie von entscheidender Bedeutung.

Ein konformes Hochrisiko-KI-System ruht auf drei fundamentalen technischen Säulen. Diese sind keine isolierten Checkboxen, sondern greifen ineinander, um ein durchgängig sicheres und zuverlässiges System zu gewährleisten.

Jedes KI-System ist nur so gut wie die Daten, mit denen es trainiert wird. Der AI Act stellt daher strenge Anforderungen an die Daten-Governance. Im Klartext: Sie müssen genau wissen, woher Ihre Daten stammen, wie sie aufbereitet wurden und welche potenziellen Schwachstellen sie haben.

Was bedeutet das konkret für Ihr Team?

Ein Hochrisiko-KI-System ist ein attraktives Ziel für Angriffe. Es muss daher von Grund auf sicher konzipiert sein („Security by Design“). Robustheit bedeutet in diesem Kontext, dass das System auch unter unerwarteten oder feindlichen Bedingungen zuverlässig funktioniert.

Was bedeutet das konkret für Ihr Team?

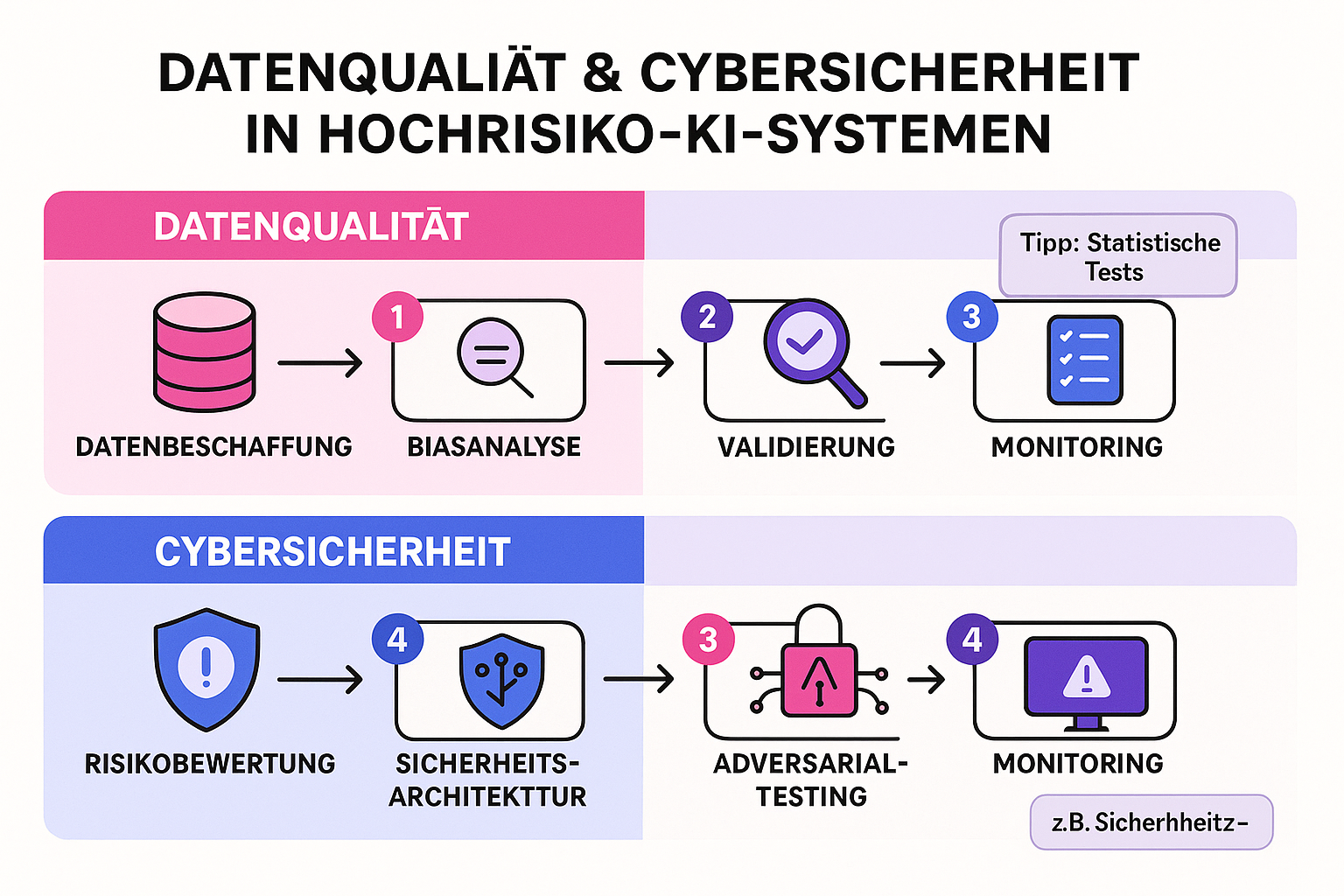

Dieses Diagramm visualisiert die wichtigsten technischen Schritte für die Sicherstellung von Datenqualität und Cybersicherheit in Hochrisiko-KI-Systemen – eine praxisorientierte Anleitung für Entwickler und Compliance-Teams.

Der AI Act stellt klar: Ein Hochrisiko-KI-System darf niemals eine vollständig autonome „Black Box“ sein. Es muss immer eine effektive menschliche Aufsicht möglich sein, um Risiken zu kontrollieren und fehlerhafte Entscheidungen zu korrigieren.

Was bedeutet das konkret für Ihr Team?

Eine der größten Herausforderungen des AI Acts ist die Pflicht zur lückenlosen technischen Dokumentation. Sie müssen nicht nur die Regeln befolgen, sondern auch nachweisen können, dass und wie Sie sie befolgen. Diese Dokumentation ist kein einmaliges Projekt, sondern ein lebendes Dokument, das mit dem KI-System weiterentwickelt wird.

Ein zentrales Element ist dabei das Qualitätsmanagementsystem (QMS). Es beschreibt alle Prozesse und Verantwortlichkeiten, die Sie zur Einhaltung der Vorschriften etabliert haben. Wenn Sie sich fragen, welche Schritte für die ISO 9001 Zertifizierung nötig sind, finden Sie dort viele Parallelen zu den Anforderungen des AI Acts an ein robustes QMS.

Die technische Dokumentation muss unter anderem Folgendes enthalten:

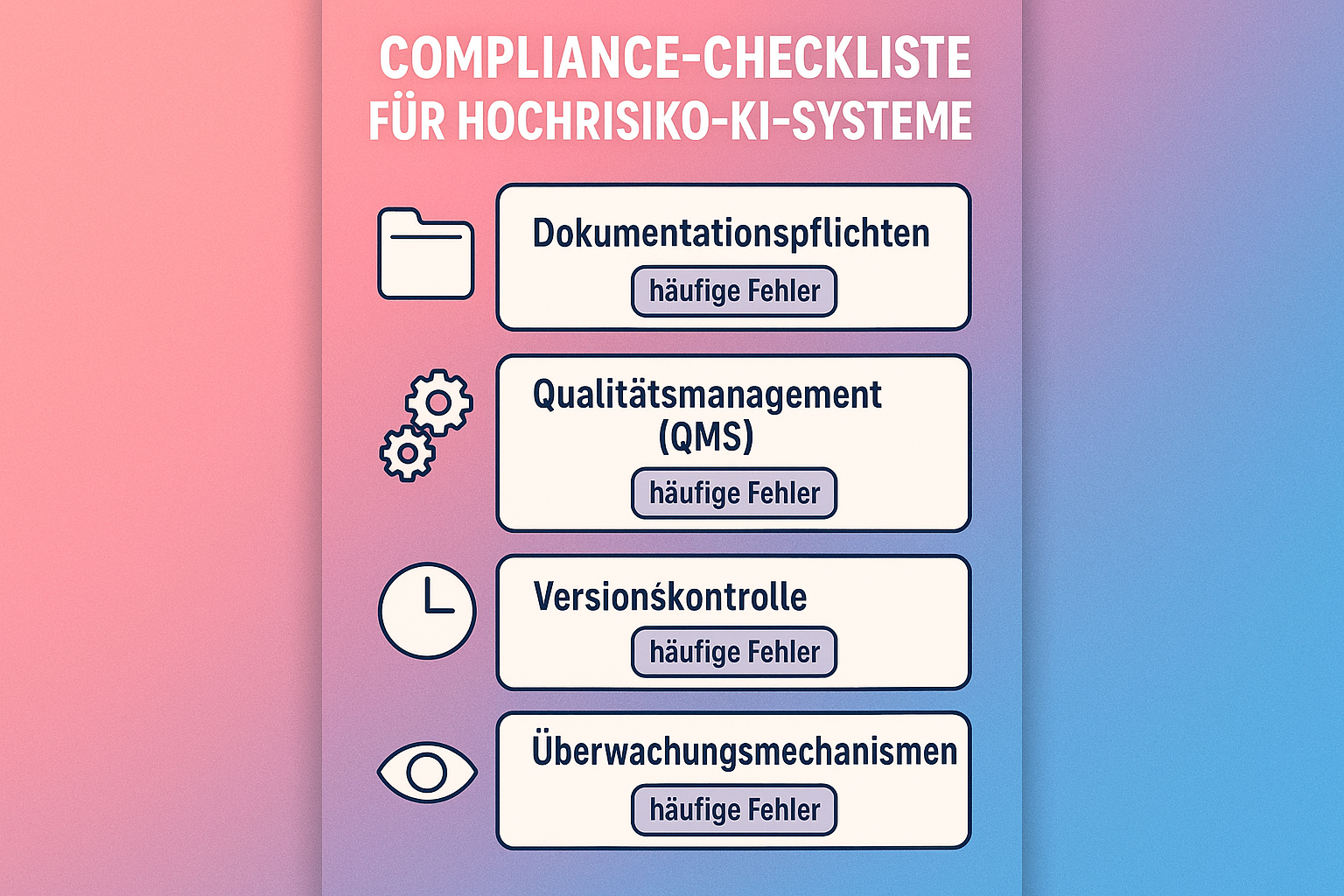

Diese Checkliste fasst die wesentlichen Pflichten zur technischen Dokumentation und Governance von Hochrisiko-KI-Systemen übersichtlich zusammen – ein unverzichtbares Merkblatt für Teams zur Einhaltung des EU AI Acts.

Die Umsetzung dieser Anforderungen ist komplex, aber mit einem strukturierten Vorgehen machbar. Hier sind Ihre nächsten Schritte:

Hochrisiko-KI-Systeme sind solche, die ein potenziell hohes Risiko für die Gesundheit, Sicherheit oder die Grundrechte von Menschen darstellen. Der AI Act listet in Anhang III spezifische Anwendungsbereiche auf, wie z. B. KI in medizinischen Geräten, in der Personalverwaltung, in der kritischen Infrastruktur oder in der Strafverfolgung.

Ein häufiges Missverständnis. Der AI Act unterscheidet zwischen „Anbietern“ (die das System entwickeln und in Verkehr bringen) und „Betreibern“ oder „Nutzern“ (die das System einsetzen). Beide Parteien haben spezifische Pflichten. Anbieter müssen das System konform gestalten und dokumentieren. Betreiber müssen es gemäß den Anweisungen verwenden, die menschliche Aufsicht sicherstellen und die Eingabedaten kontrollieren.

Nein. Compliance ist ein kontinuierlicher Prozess. Hochrisiko-KI-Systeme müssen über ihren gesamten Lebenszyklus hinweg überwacht werden (Post-Market Monitoring). Das gilt insbesondere für Systeme, die kontinuierlich lernen und sich verändern. Jede wesentliche Änderung erfordert eine erneute Konformitätsbewertung.

Die Dokumentation ist sehr umfassend. Sie muss unter anderem die Architektur, die verwendeten Daten, die Algorithmen, die Maßnahmen zur Cybersicherheit und menschlichen Aufsicht, die Leistungsmetriken sowie die Risiko- und Qualitätsmanagementprozesse detailliert beschreiben. Sie dient als zentraler Nachweis gegenüber den Behörden.

Als Jurist mit langjähriger Erfahrung als Anwalt für Datenschutz und IT-Recht kennt Niklas die Antwort auf so gut wie jede Frage im Bereich der digitalen Compliance. Er war in der Vergangenheit unter anderem für Taylor Wessing und Amazon tätig. Als Gründer und Geschäftsführer von SECJUR, lässt Niklas sein Wissen vor allem in die Produktentwicklung unserer Compliance-Automatisierungsplattform einfließen.

SECJUR steht für eine Welt, in der Unternehmen immer compliant sind, aber nie an Compliance denken müssen. Mit dem Digital Compliance Office automatisieren Unternehmen aufwändige Arbeitsschritte und erlangen Compliance-Standards wie DSGVO, ISO 27001 oder TISAX® bis zu 50% schneller.

Automatisieren Sie Ihre Compliance Prozesse mit dem Digital Compliance Office

Die häufigsten Fragen zum Thema

NIS2 verlangt die Absicherung der Lieferkette. Dieser Artikel zeigt, wie Sie Lieferanten klassifizieren, vertraglich absichern und regelmäßig auditieren.

Managementbewertung nach ISO 9001: Definition, Inputs, Outputs und praktische Vorbereitung. Erfahren Sie, wie Sie Management Reviews dokumentieren und durchführen.

Erfahren Sie, welche Haftungs- und Sanktionsrisiken Nicht-EU-KI-Anbieter durch den EU AI Act im Binnenmarkt beachten müssen.