Volljurist und Compliance-Experte

07 Jan 2026

5 Minuten

Als Jurist mit langjähriger Erfahrung als Anwalt für Datenschutz und IT-Recht kennt Niklas die Antwort auf so gut wie jede Frage im Bereich der digitalen Compliance. Er war in der Vergangenheit unter anderem für Taylor Wessing und Amazon tätig. Als Gründer und Geschäftsführer von SECJUR, lässt Niklas sein Wissen vor allem in die Produktentwicklung unserer Compliance-Automatisierungsplattform einfließen.

Der EU AI Act macht mangelhafte KI-Compliance zu einem direkten Haftungsrisiko.

Durch die Beweislastumkehr müssen Unternehmen die Unschuld ihrer KI aktiv belegen.

Technische Dokumentation wird zur wichtigsten Absicherung gegen Schadensersatz.

Human Oversight ist ein zentraler Schutzmechanismus gegen KI-bedingte Schäden.

Stellen Sie sich folgendes Szenario vor: Ein autonomer Industrieroboter in einer modernen Fertigungshalle greift plötzlich daneben. Er beschädigt nicht nur teures Material, sondern verletzt dabei leicht einen Mitarbeiter. Die klassische Frage wäre nun: War der Roboter defekt?

Doch bei Künstlicher Intelligenz ist die Antwort selten einfach. War es ein Fehler im Code? Hatte die KI schlechte Trainingsdaten? Oder hat das System in einer "Black Box"-Entscheidung etwas getan, das selbst die Entwickler nicht vorhersehen konnten?

Bisher stießen Geschädigte hier oft auf eine Mauer des Schweigens – oder besser gesagt, der technischen Undurchsichtigkeit. Genau hier greift das neue europäische Regelwerk ein. Die Interaktion zwischen dem neuen EU AI Act und den bewährten Produkthaftungsgesetzen schafft völlig neue Spielregeln für Unternehmen.

Dieser Artikel nimmt Sie mit auf eine Reise durch den Paragrafen-Dschungel und zeigt Ihnen, warum Compliance plötzlich zur besten Versicherung gegen Schadensersatzklagen wird.

Bevor wir analysieren, wie die Gesetze ineinandergreifen, müssen wir verstehen, wer hier eigentlich gegeneinander antritt (oder zusammenspielt).

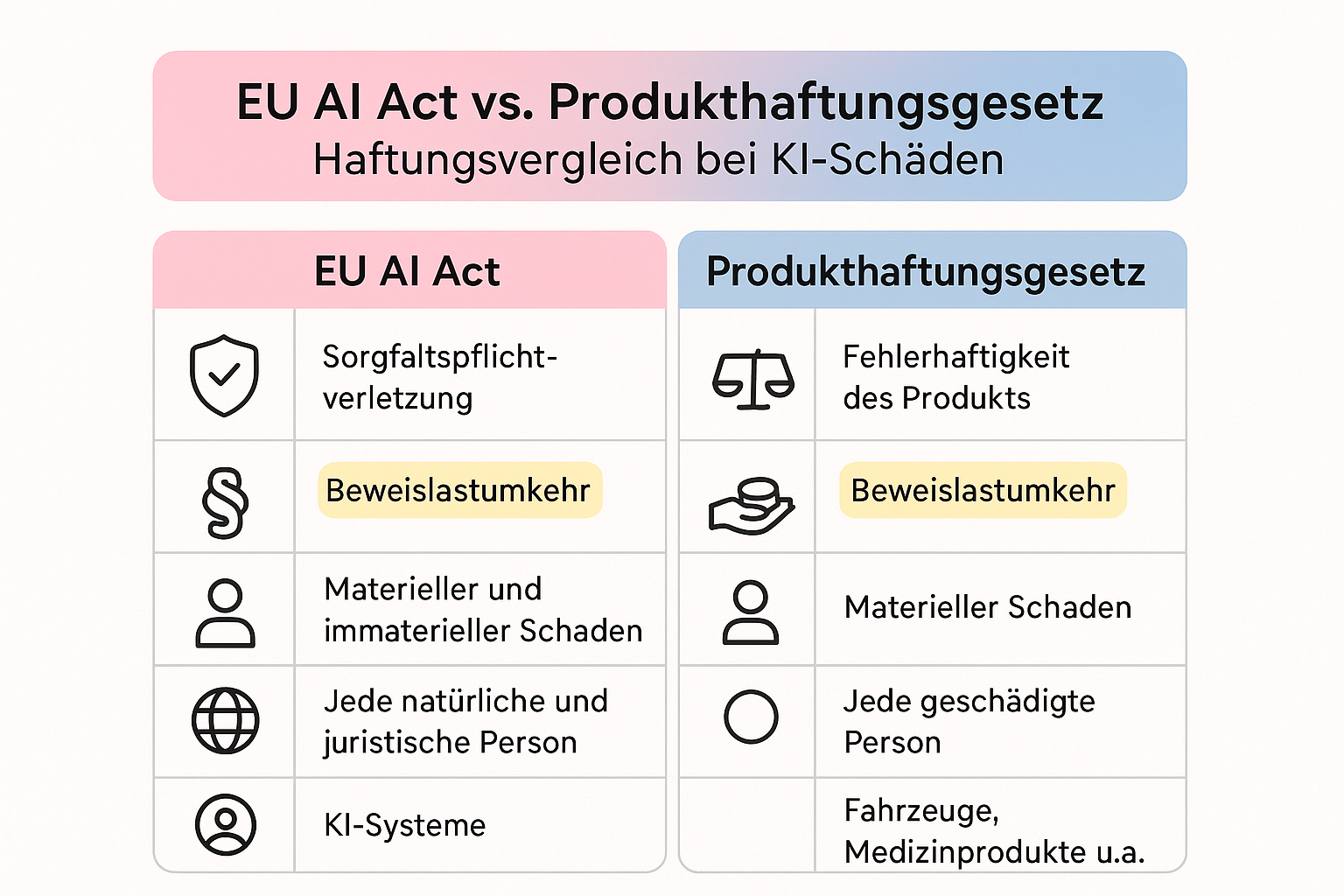

Seit Jahrzehnten gilt in Deutschland und der EU das Prinzip der verschuldensunabhängigen Haftung für fehlerhafte Produkte. Wenn Ihr Toaster explodiert, haftet der Hersteller – egal, ob ihn eine persönliche Schuld trifft. Der Fokus liegt auf dem Fehler im Produkt zum Zeitpunkt des Inverkehrbringens.

Der EU AI Act ist primär ein Produktsicherheitsgesetz. Er definiert Pflichten, damit KI erst gar keinen Schaden anrichtet. Doch flankierend dazu reformiert die EU die Haftungsregeln, um das "Black Box"-Problem zu lösen. Das Kernproblem war bisher: Als Geschädigter mussten Sie beweisen, dass die KI einen Fehler gemacht hat. Bei komplexen Algorithmen ist das für Laien (und selbst Experten) oft unmöglich.

Hier kommt die Schnittstelle ins Spiel: Der AI Act liefert die "Soll-Vorgaben" (z.B. Datenqualität, Dokumentation). Werden diese verletzt, ändert sich die haftungsrechtliche Lage drastisch.

Um zu verstehen, ob Ihr Produkt unter diese strengen Regeln fällt, ist es essenziell zu wissen, welche Risikoklassen der EU AI Act definiert. Denn die Haftungsschärfe korreliert direkt mit dem Risikolevel des Systems.

Die spannendste Neuerung ist die Interaktion zwischen der technischen Compliance (AI Act) und der juristischen Haftung (Produkthaftung).

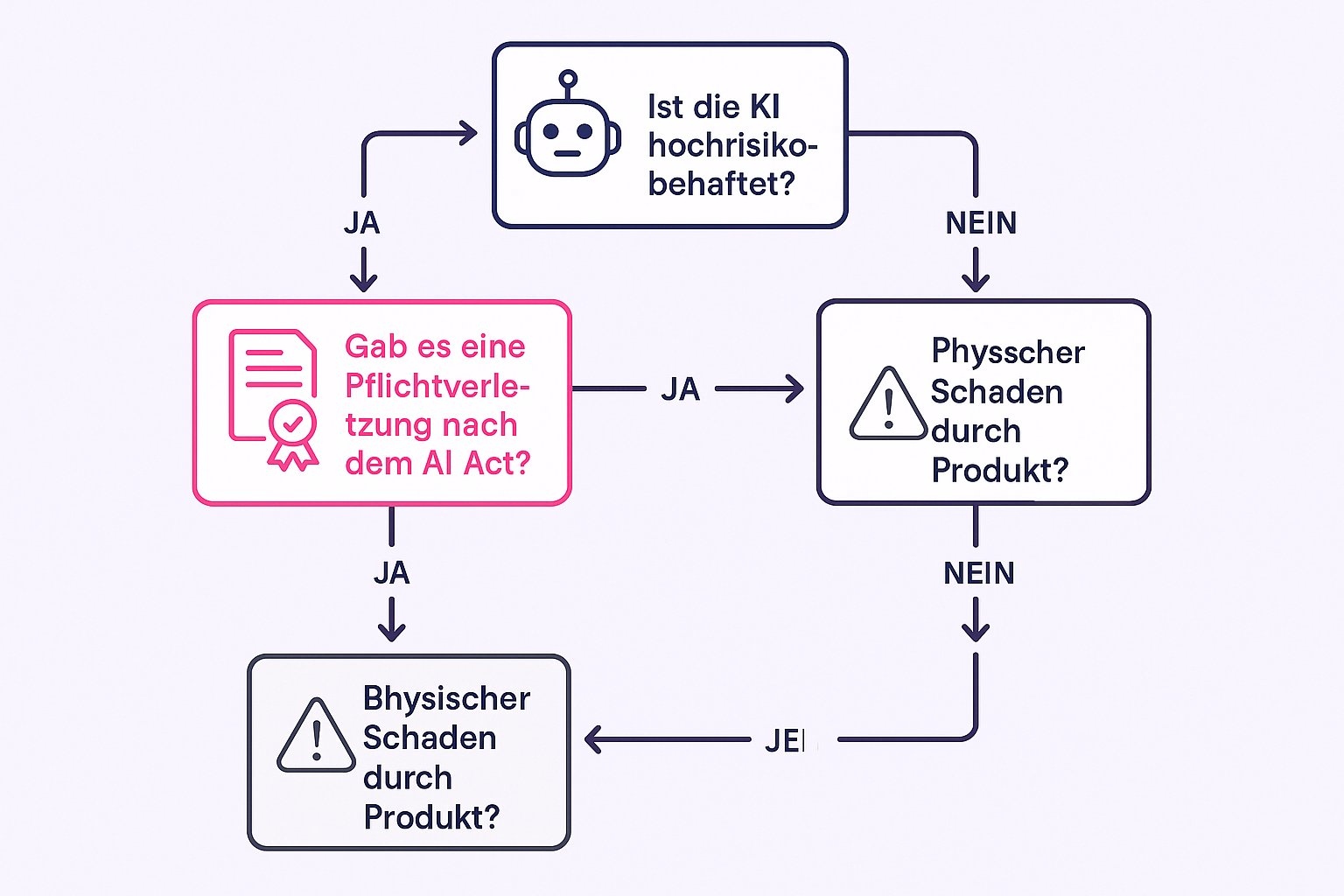

Das ist der zentrale Hebel, den der Gesetzgeber umgelegt hat. Bisher musste der Geschädigte den Fehler und den ursächlichen Zusammenhang zum Schaden beweisen.

Unter dem neuen Regime gilt: Wenn ein Unternehmen gegen die Pflichten des AI Acts verstößt (z.B. mangelhafte Dokumentation oder fehlende menschliche Aufsicht) und ein Schaden entsteht, der plausibel durch diesen Fehler verursacht wurde, vermutet das Gericht, dass die KI schuld ist.

Das Unternehmen muss dann beweisen, dass seine KI nicht ursächlich war. Diese Beweislastumkehr ist für Unternehmen ein enormes Risiko, wenn ihre Compliance-Prozesse Lücken aufweisen.

In der Praxis ergänzen sich die Gesetze meist, aber es gibt Konfliktlinien:

Lifecycle Management). Ein Fehler, der durch ein "Lernen" der KI nach drei Jahren entsteht, fällt nun leichter auf den Anbieter zurück, wenn er keine hinreichenden Monitoring-Systeme etabliert hat.

Besonders wichtig ist hier das Konzept der Human Oversight (Deutsch: menschliche Aufsicht). Wenn ein Hochrisiko-System autonom agiert, ohne dass ein Mensch eingreifen kann, ist dies oft per se ein Compliance-Verstoß, der die Tür für Haftungsklagen weit öffnet.

Theorie ist gut, aber wie sieht das im Gerichtsfall aus? Schauen wir uns drei Szenarien an.

Eine KI-Software zur Krebsfrüherkennung übersieht einen Tumor. Der Patient erleidet gesundheitliche Schäden.

Ein HR-Tool sortiert systematisch Frauen aus. Eine Bewerberin klagt auf Schadensersatz wegen Entgangs einer Chance.

Ein Entwickler stellt ein KI-Modell kostenlos auf GitHub. Ein Unternehmen nutzt es und verursacht einen Schaden.

Die Botschaft ist klar: Die Einhaltung technischer Standards ist keine reine Bürokratie mehr – sie ist Ihre juristische Lebensversicherung. Dokumentation schützt vor der Beweislastumkehr.

Die Interaktion von AI Act und Produkthaftung wirkt auf den ersten Blick einschüchternd. Doch sie bietet auch eine Chance: Unternehmen, die ihre Compliance-Prozesse jetzt sauber aufsetzen, bauen nicht nur rechtliche Hürden ab, sondern signalisieren ihren Kunden Vertrauen und Sicherheit.

In einer Welt, in der KI-Entscheidungen immer komplexer werden, ist Transparenz das wertvollste Gut. Wenn Sie tiefer in die technischen Anforderungen eintauchen möchten, um Haftungsfallen zu vermeiden, lohnt sich ein Blick auf die AI Act Anforderungen (KRITIS) und wie diese Standards die Basis für Ihre Rechtssicherheit bilden.

Ja, wenn die KI als "Produkt" klassifiziert wird, kann auch bei kostenlosen Angeboten eine Haftung entstehen, insbesondere wenn personenbezogene Daten als "Gegenleistung" genutzt werden oder Schäden an Gesundheit/Eigentum entstehen.

Das hängt von der Rolle ab. Der Provider (Hersteller) haftet für die Konformität des Systems. Der Deployer (Nutzer/Unternehmen) kann haften, wenn er die KI falsch einsetzt oder Anweisungen (z.B. zur menschlichen Aufsicht) ignoriert.

Eine Zertifizierung (z.B. CE-Kennzeichnung nach AI Act) ist ein starkes Indiz dafür, dass Sie sorgfältig gehandelt haben. Sie verhindert die Beweislastumkehr oft effektiv, schließt aber eine Haftung nicht zu 100% aus, wenn trotz Zertifikat ein offensichtlicher Fehler vorlag.

Wer eine allgemeine KI (GPAI) in ein spezifisches Produkt integriert und unter eigenem Namen anbietet, wird oft selbst zum "Provider" und übernimmt damit die vollen Haftungsrisiken für das Endprodukt.

Als Jurist mit langjähriger Erfahrung als Anwalt für Datenschutz und IT-Recht kennt Niklas die Antwort auf so gut wie jede Frage im Bereich der digitalen Compliance. Er war in der Vergangenheit unter anderem für Taylor Wessing und Amazon tätig. Als Gründer und Geschäftsführer von SECJUR, lässt Niklas sein Wissen vor allem in die Produktentwicklung unserer Compliance-Automatisierungsplattform einfließen.

SECJUR steht für eine Welt, in der Unternehmen immer compliant sind, aber nie an Compliance denken müssen. Mit dem Digital Compliance Office automatisieren Unternehmen aufwändige Arbeitsschritte und erlangen Compliance-Standards wie DSGVO, ISO 27001 oder TISAX® bis zu 50% schneller.

Automatisieren Sie Ihre Compliance Prozesse mit dem Digital Compliance Office

Die häufigsten Fragen zum Thema

Viele Webseiten verfügen über eine Datenschutzerklärung. Aber benötigt wirkliche jede Internetseite eine Datenschutzerklärung? Muss auch die Homepage einer Privatperson eine Datenschutzerklärung haben? Die SECJUR-Datenschutzexperten klären auf.

Das NIS2UmsuCG verpflichtet rund 30.000 Unternehmen zu zehn Risikomanagement-Maßnahmen nach §30 BSIG. Alle Anforderungen, ISO 27001 Mapping und eine Umsetzungs-Roadmap.

In den vergangenen zwei Jahren waren Verstöße gegen Datenschutzbestimmungen für nur 6 % der Befragten überhaupt relevant. Dies wird sich in den kommenden Jahren erheblich ändern. So sehen es zumindest die fast 200 befragten Entscheider aus Unternehmen ab 250 Mitarbeitern, die an der Studie „Crisis Management“ der Kanzlei Noerr teilnahmen.